Kurz już opadł na We/Wy Google 2024 myśl przewodnią i nie ma wątpliwości, jaki był główny temat – Google Bliźnięta a nowe narzędzia AI całkowicie zdominowały ogłoszenia, dając nam wgląd w to, dokąd zmierza nasze cyfrowe życie. Dyrektor generalny Sundar Pichai słusznie określił to wydarzenie jako wersję The Eras Tour – a konkretnie „Erę Bliźniąt” – na samym szczycie.

W przeciwieństwie do poprzednich lat całe przemówienie dotyczyło Bliźniąt i sztucznej inteligencji; W rzeczywistości, Google powiedział ten ostatni łącznie 121 razy. Od zaprezentowania futurystycznego asystenta AI o nazwie „Projekt Astra”, który może działać na telefonie – a może pewnego dnia na inteligentnych okularach – po dodanie Gemini do niemal każdej usługi lub produktu oferowanego przez firmę, sztuczna inteligencja była zdecydowanie dominującym tematem.

Dwugodzinne przemówienie wystarczyło, aby roztopić umysły wszystkich oprócz najbardziej zagorzałych entuzjastów LLM, dlatego wyszczególniliśmy 7 najważniejszych rzeczy, które Google ogłosił podczas swojego głównego przemówienia I/O 2024 – i zamieściliśmy najnowsze wiadomości na temat tego, kiedy faktycznie moglibyśmy zobaczyć te nowe narzędzia…

1. Google porzucił Project Astra – „agenta AI” na co dzień

Okazuje się, że Google rzeczywiście ma odpowiedź na to pytanie OpenAI GPT-4o I MicrosoftuCoPilot. Projekt Astranazwany „agentem sztucznej inteligencji” na co dzień, jest zasadniczo Obiektyw Google’a na sterydach i wygląda naprawdę imponująco, jest w stanie zrozumieć, rozumować i reagować na wideo i audio na żywo.

Na nagranym filmie pokazanym na telefonie Pixel użytkownik chodził po biurze, transmitował na żywo obraz z tylnej kamery i zadawał Astrze pytania. Gemini oglądał i rozumiał elementy wizualne, jednocześnie zadając pytania.

Odwołuje się do wielomodalnego i długiego kontekstu zaplecza Gemini, które działa błyskawicznie, szybko identyfikując i dostarczając odpowiedź. Podczas demonstracji wiedział, jaka jest konkretna część mówiącego, a nawet potrafił zidentyfikować dzielnicę w Londynie. Ma także charakter generatywny, ponieważ szybko stworzył nazwę zespołu dla uroczego szczeniaka obok pluszaka (zobacz film powyżej).

Nie zostanie to wprowadzone od razu, ale programiści i prasa taka jak my z TechRadar będą mogli wypróbować to rozwiązanie podczas I/O 2024. I choć Google nie wyjaśnił tego, pojawił się zwiastun okularów dla Astry, co może oznaczać Google Szkło może powrócić.

Mimo to, nawet jako wersja demonstracyjna podczas Google I/O, robi ona naprawdę wrażenie i jest potencjalnie bardzo przekonująca. Może doładować smartfony i obecnych asystentów, których mamy od Google, a nawet Jabłko. Co więcej, pokazuje także prawdziwe ambicje Google w zakresie sztucznej inteligencji – narzędzia, które może być niezwykle pomocne i nie wymagać żadnego wysiłku w użyciu.

- Kiedy zostanie uruchomiony? Na razie nieznane – Google opisuje to jako „naszą wizję przyszłości asystentów AI”

2. Zdjęcia Google otrzymały przydatne wsparcie AI od Gemini

Czy kiedykolwiek chciałeś szybko znaleźć konkretne zdjęcie, które zrobiłeś w odległej przeszłości? Może to być notatka od ukochanej osoby, wczesne zdjęcie psa jako szczenięcia, a nawet tablica rejestracyjna. Cóż, Google urzeczywistnia to życzenie dzięki dużej aktualizacji Zdjęcia Google który łączy go z Bliźniakami. Daje mu to dostęp do Twojej biblioteki, umożliwia jej przeszukiwanie i łatwe dostarczanie wyników, których szukasz.

Podczas demonstracji na scenie Sundar Pichai ujawnił, że możesz poprosić o tablicę rejestracyjną, a firma Photos dostarczy obraz przedstawiający tablicę rejestracyjną oraz cyfry/znaki tworzące tablicę rejestracyjną. Podobnie możesz poprosić o zdjęcia pokazujące, kiedy Twoje dziecko nauczyło się pływać, wraz ze wszystkimi szczegółami. Powinno to ułatwić przeszukiwanie nawet najbardziej zdezorganizowanych bibliotek zdjęć.

Google nazwał tę funkcję „Zapytaj zdjęcia” i udostępni ją wszystkim użytkownikom w „nadchodzących tygodniach”. I prawie na pewno się przyda i przyda ludziom, którzy nie używają Zdjęcia Google trochę zazdrosny.

3. Praca domowa Twojego dziecka właśnie stała się o wiele łatwiejsza dzięki NotebookLM

Wszyscy rodzice znają horror pomagania dzieciom w odrabianiu zadań domowych; Jeśli kiedykolwiek wiedziałeś o tych rzeczach w przeszłości, nie ma mowy, żeby ta wiedza nadal czaiła się w twoim mózgu 20 lat później. Ale być może Google właśnie znacznie ułatwił to zadanie dzięki aktualizacji aplikacji do robienia notatek NotebookLM.

NotebookLM ma teraz dostęp do Gemini 1.5 Pro i na podstawie wersji demonstracyjnej przedstawionej na konferencji I/O 2024 będzie teraz lepszym nauczycielem niż kiedykolwiek wcześniej. Demo pokazało, jak Josh Woodward z Google ładuje notatnik wypełniony notatkami na temat nauczania – w tym przypadku nauki. Za jednym naciśnięciem przycisku był w stanie stworzyć szczegółowy przewodnik edukacyjny zawierający dalsze wyniki, w tym quizy i często zadawane pytania, wszystkie zaczerpnięte z materiałów źródłowych.

Robi wrażenie – ale miało być znacznie lepiej. Nowa funkcja – na razie jeszcze prototyp – umożliwiała wyświetlenie całej zawartości w formacie audio, tworząc zasadniczo dyskusję w stylu podcastu. Co więcej, w nagraniu uczestniczyło więcej niż jeden mówca, rozmawiający na dany temat w naturalny sposób w sposób, który z pewnością byłby bardziej pomocny niż sfrustrowany rodzic próbujący odgrywać rolę nauczyciela.

Woodward był nawet w stanie przerwać i zadać pytanie, w tym przypadku „podać przykład koszykówki” – w tym momencie sztuczna inteligencja zmieniła taktykę i wymyśliła sprytne metafory na ten temat, ale w przystępnym kontekście. Rodzice z zespołu TechRadar nie mogą się doczekać wypróbowania tego.

- Kiedy zostanie uruchomiony? Nieznane w tej chwili

4. Wkrótce będziesz mógł wyszukiwać w Google za pomocą wideo

Podczas dziwnego pokazu na scenie z gramofonem Google zaprezentował nową, imponującą sztuczkę wyszukiwania. Możesz teraz nagrać film i przeszukać go, aby uzyskać wyniki i, miejmy nadzieję, odpowiedź.

W tym przypadku to Googler zastanawiał się, jak wykorzystać gramofon; nacisnęła przycisk „Nagraj”, aby sfilmować daną jednostkę, jednocześnie o coś zadając pytanie, po czym wysłała nagranie. Google zastosował magię wyszukiwania i dostarczył odpowiedź w formie tekstowej, którą można było przeczytać na głos. To zupełnie nowy sposób wyszukiwania, np Obiektyw Google’a do wideo, a także wyraźnie różni się od przyszłej sztucznej inteligencji Project Astra, ponieważ należy to nagrać, a następnie przeszukać, a nie pracować w czasie rzeczywistym.

Mimo to jest to część połączenia Gemini i generatywnej sztucznej inteligencji z wyszukiwarką Google, której celem jest utrzymanie Cię na tej stronie i ułatwienie uzyskania odpowiedzi. Przed demonstracją wyszukiwania za pomocą wideo Google zaprezentowało nowe, generatywne doświadczenie w zakresie przepisów i posiłków. Dzięki temu możesz wyszukiwać coś w języku naturalnym i otrzymywać przepisy, a nawet rekomendacje lokali gastronomicznych na stronie wyników.

Mówiąc najprościej, Google intensywnie wykorzystuje generatywną sztuczną inteligencję w wyszukiwaniu, zarówno pod kątem wyników, jak i różnych sposobów ich uzyskiwania.

- Kiedy zostanie uruchomiony? Google twierdzi, że „wyszukiwanie za pomocą wideo będzie wkrótce dostępne dla użytkowników Search Labs w języku angielskim w USA” i „z czasem rozszerzy się na więcej regionów”

Zachwycaliśmy się twórczością OpenAInarzędzie do zamiany tekstu na wideo Sora przez ostatnie kilka miesięcy, a teraz jest to Google dołącz do generatywnej imprezy wideo z nowym narzędziem o nazwie Veo. Podobnie jak Sora, Veo może generować minutowe filmy w jakości 1080p, a wszystko to za pomocą prostego polecenia.

Monit ten może zawierać efekty kinowe, takie jak prośba o wykonanie zdjęcia poklatkowego lub zdjęcia lotniczego, a także wczesne próbki wyglądają imponująco. Nie musisz też zaczynać od zera – prześlij wideo wejściowe za pomocą polecenia, a Veo będzie mogło edytować klip zgodnie z Twoimi żądaniami. Istnieje również możliwość dodawania masek i modyfikowania określonych części wideo.

Złe wiadomości? Podobnie jak Sora, Veo nie jest jeszcze powszechnie dostępne. Google twierdzi, że będzie dostępna dla wybranych twórców za pośrednictwem VideoFX, jednej z eksperymentalnych funkcji laboratorium, „w nadchodzących tygodniach”. Może minąć trochę czasu, zanim zobaczymy szerokie wdrożenie, ale Google obiecał udostępnić tę funkcję Youtube Shorty i inne aplikacje. I to będzie miało Cegła suszona na słońcu poruszając się niespokojnie na krześle stworzonym przez sztuczną inteligencję.

- Kiedy zostanie uruchomiony? Możesz teraz dołącz do listy oczekujących Veoa Google stwierdziło, że będzie „dostępne dla wybranych twórców w prywatnym podglądzie w VideoFX”. Google twierdzi również, że „w przyszłości udostępnimy niektóre możliwości Veo także w YouTube Shorts” i innych produktach

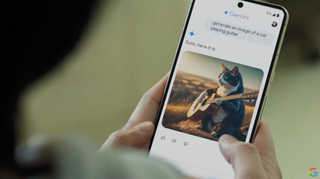

6. Android dostał duży napar Gemini

Podobnie jak funkcja Google „Circle to Search” dostępna na aplikacji, Gemini jest teraz integrowane z rdzeniem Androida, aby integrować się z Twoim przepływem informacji. Jak pokazano, Gemini może teraz przeglądać, czytać i rozumieć zawartość ekranu Twojego telefonu, pozwalając mu przewidywać pytania dotyczące tego, co przeglądasz.

Dzięki temu może poznać kontekst oglądanego filmu, przewidzieć prośbę o podsumowanie podczas przeglądania obszernego pliku PDF lub przygotować się na niezliczone pytania dotyczące aplikacji, w której się znajdujesz. Sztuczna inteligencja rozpoznająca zawartość wbudowana w system operacyjny telefonu jest niemożliwa W żadnym wypadku nie jest to nic złego i może okazać się bardzo przydatne.

Oprócz integracji Gemini na poziomie systemu, Gemini Nano z Multimodalnością zostanie wprowadzone na rynek jeszcze w tym roku na urządzeniach Pixel. Co umożliwi? Cóż, powinno to przyspieszyć działanie, ale na razie przełomową funkcją jest to, że Gemini podsłuchuje połączenia i powiadamia Cię w czasie rzeczywistym, jeśli jest to spam. To całkiem fajne rozwiązanie i opiera się na sprawdzaniu połączeń, będącej od dawna funkcją telefonów Pixel. Ma działać szybciej i przetwarzać więcej na urządzeniu, zamiast wysyłać je do chmury.

- Kiedy zostanie uruchomiony? Google twierdzi, że „Gemini Nano z multimodalnością” będzie dostępne „na Pixelu jeszcze w tym roku”. Ulepszenia Circle to Search i nowa funkcja oszustw bankowych w przypadku połączeń telefonicznych również pojawią się „jeszcze w tym roku”

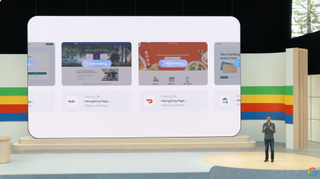

7. Google Workspace stanie się dużo mądrzejszy

Użytkownicy Workspace są zdobywając skarbnicę integracji i przydatnych funkcji Gemini co mogłoby mieć duży wpływ każdego dnia. W Mail, dzięki nowemu panelowi bocznemu po lewej stronie, możesz poprosić Gemini o podsumowanie wszystkich ostatnich rozmów ze współpracownikiem. Wynik jest następnie podsumowywany w punktach, podkreślających najważniejsze aspekty.

Gemini w Google Meet może przekazać Ci najważniejsze momenty spotkania lub pytania, o które mogą pytać inne osoby biorące udział w rozmowie. Nie będziesz już musiał robić notatek podczas tej rozmowy, co może okazać się pomocne, jeśli jest długie. W Arkuszach Google Gemini może pomóc w zrozumieniu danych i przetwarzaniu żądań, takich jak pobieranie określonej sumy lub zbioru danych.

Najbardziej futurystycznym przykładem może być wirtualny członek drużyny „Chip”. Może działać na czacie G i być wywoływany w celu wykonania różnych zadań lub zapytań. Chociaż narzędzia te trafią do Workspace, prawdopodobnie najpierw w Laboratorium, pozostaje pytanie, kiedy trafią do zwykłych klientów Gmaila i Dysku. Biorąc pod uwagę podejście Google do sztucznej inteligencji dla wszystkich i nacisk na wyszukiwanie, jest to prawdopodobnie kwestia czasu.

- Kiedy zostanie uruchomiony? Panel boczny Gemini w Gmailu, Dokumentach, Dysku, Prezentacjach i Arkuszach zostanie zaktualizowany do wersji Gemini 1.5 Pro „od dzisiaj” (14 maja). W aplikacji Gmail funkcja „podsumowania e-maili” będzie dostępna dla użytkowników Workspace Labs „w tym miesiącu” (maj), a dla klientów Gemini for Workspace i subskrybentów Google One AI Premium „w przyszłym miesiącu”