Zaledwie dzień po ujawnieniu OpenAI GPT-4oco według niego oznacza zdolność rozumienia tego, co dzieje się na kanale wideo i rozmawiania na ten temat, oznajmił Google Projekt Astraprototyp badawczy, który oferuje podobne możliwości rozumienia wideo. Zostało to ogłoszone przez dyrektora generalnego Google DeepMind, Demisa Hassabisa, we wtorek podczas przemówienia na konferencji Google I/O w Mountain View w Kalifornii.

Hassabis nazwał Astrę „uniwersalnym środkiem pomocnym w życiu codziennym”. Podczas demonstracji model badawczy zaprezentował swoje możliwości, identyfikując obiekty wytwarzające dźwięk, dostarczając kreatywne aliteracje, wyjaśniając kod na monitorze i lokalizując zagubione elementy. Asystent AI pokazał także swój potencjał w urządzeniach do noszenia, takich jak inteligentne okulary, gdzie mógł analizować diagramy, sugerować ulepszenia i generować dowcipne odpowiedzi na podpowiedzi wizualne.

Google twierdzi, że Astra wykorzystuje kamerę i mikrofon w urządzeniu użytkownika, aby zapewnić pomoc w codziennym życiu. Poprzez ciągłe przetwarzanie i kodowanie klatek wideo i mowy, Astra tworzy oś czasu zdarzeń i buforuje informacje w celu szybkiego przywołania. Firma twierdzi, że umożliwia to sztucznej inteligencji identyfikowanie obiektów, odpowiadanie na pytania i zapamiętywanie rzeczy, które widziała, a których nie ma już w kadrze kamery.

Project Astra: wizja Google dotycząca przyszłości asystentów AI.

Chociaż Projekt Astra pozostaje funkcją na wczesnym etapie i nie ma konkretnych planów wprowadzenia na rynek, Google zasugerował, że niektóre z tych funkcji mogą zostać zintegrowane z produktami takimi jak aplikacja Gemini jeszcze w tym roku (w ramach funkcji o nazwie „Gemini Live”), co będzie znaczącym krokiem naprzód w rozwoju pomocnych asystentów AI. Chodzi o stworzenie agenta z „agencją”, który potrafi „myśleć z wyprzedzeniem, rozumować i planować w Twoim imieniu”, jak mówi dyrektor generalny Google, Sundar Pichai.

Gdzie indziej w Google AI: 2 miliony tokenów

Podczas Google I/O firma ujawniła dużą liczbę ogłoszeń związanych ze sztuczną inteligencją, z których część być może w przyszłości omówimy w osobnych wpisach. Ale na razie oto krótki przegląd.

Na początku przemówienia Pichai wspomniał o „ulepszonej” wersji lutowej Bliźnięta 1.5 Pro (co dziwne, ten sam numer wersji), który już wkrótce. Będzie wyposażony w okno kontekstowe zawierające 2 miliony tokenów, co oznacza, że będzie w stanie przetwarzać jednocześnie dużą liczbę dokumentów lub długie fragmenty zakodowanych filmów. Tokeny to fragmenty danych, które modele języka AI wykorzystują do przetwarzania informacji, a okno kontekstowe określa maksymalną liczbę tokenów, które model AI może przetworzyć jednocześnie. Obecnie wersja 1.5 Pro osiąga maksymalnie 1 milion tokenów (dla porównania GPT-4 Turbo OpenAI ma okno na 128 000 tokenów).

Zapytaliśmy badacza sztucznej inteligencji Simona Willisona – który nie pracuje dla Google, ale pojawił się w filmie promocyjnym podczas przemówienia – co sądzi o ogłoszeniu w oknie kontekstowym. „Dwa miliony tokenów to ekscytująca wiadomość” – odpowiedział SMS-em, siedząc wśród głównych słuchaczy. „Warto jednak pamiętać o cenie: 7 dolarów za milion tokenów oznacza, że pojedynczy monit może kosztować 14 dolarów!” Google opłaty 7 USD za milion tokenów wejściowych za 1,5 w przypadku monitów dłuższych niż 150 000 tokenów za pośrednictwem interfejsu API.

A skoro mowa o tokenach, Google ogłosił, że ogłoszone wcześniej okno kontekstowe na 1 milion tokenów dla Gemini 1.5 Pro wreszcie się pojawi Bliźnięta zaawansowane abonentów. Wcześniej było to dostępne tylko w API.

Google ogłosiło także nowy model sztucznej inteligencji o nazwie Gemini 1.5 Flashktórą reklamowano jako lekką, szybszą i tańszą wersję Gemini 1.5. „1.5 Flash to najnowszy dodatek do rodziny modeli Gemini i najszybszy model Gemini obsługiwany w interfejsie API. Jest zoptymalizowany pod kątem zadań wymagających dużej objętości i częstotliwości oraz dużej skali” – mówi Google.

Willison również skomentował Flasha: „Nowy model Gemini Flash jest w tym przypadku obiecujący, ma zapewnić do 2 milionów tokenów w niższej cenie”. Flash kosztuje 0,35 USD za milion tokenów w przypadku podpowiedzi zawierających do 128 000 tokenów i 0,70 USD za milion tokenów w przypadku podpowiedzi dłuższych niż 128 000. To jedna dziesiąta ceny 1.5 Pro.

„35 centów za milion tokenów! To najważniejsza wiadomość dnia, IMO” – powiedział nam Willison.

Google również ogłosiło Klejnotyco wydaje się być jego podejściem do OpenAI GPT. Klejnoty to niestandardowe role chatbota Google Gemini, które będą odgrywać zdefiniowaną przez Ciebie rolę, umożliwiając personalizację Gemini na różne sposoby. Google wymienia przykłady potencjalnych Klejnotów jako „kumpel z siłowni, zastępca szefa kuchni, partner w programowaniu lub przewodnik kreatywnego pisania”.

Nowe generatywne modele AI

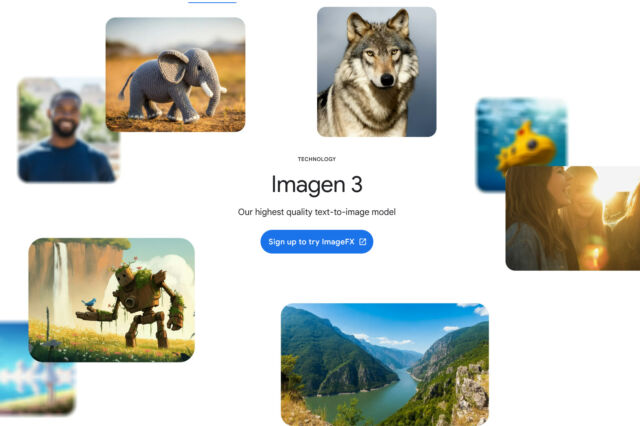

Również we wtorek podczas przemówienia Google I/O firma Google ogłosiła kilka nowych generatywnych modeli sztucznej inteligencji do tworzenia obrazów, dźwięku i wideo. Obraz 3 to najnowszy model z linii modeli syntezy obrazu, który według Google jest „najwyższej jakości modelem zamiany tekstu na obraz, zdolnym do generowania obrazów o jeszcze większej szczegółowości, bogatszym oświetleniu i mniejszej liczbie rozpraszających artefaktów niż nasze poprzednie modele”.

Google zaprezentowało także Music AI Sandbox, którą Google reklamuje jako „zestaw narzędzi AI zmieniających sposób tworzenia muzyki”. Łączy swoje Projekt muzyczny YouTube z jego Liria Generator muzyki AI w narzędzia dla muzyków.

Firma ogłosiła również Google Szpiegujęktóry jest generatorem zamiany tekstu na wideo, który tworzy filmy 1080P na podstawie podpowiedzi w jakości, która wydaje się odpowiadać OpenAI Sora. Google twierdzi, że współpracuje z aktorem Donaldem Gloverem nad stworzeniem filmu demonstracyjnego generowanego przez sztuczną inteligencję, który wkrótce zadebiutuje. To daleko od Google pierwszy generator wideo AIale wydaje się, że jest jak dotąd najpotężniejszy.

W powyższym przykładowym filmie, udostępnionym przez Google, zastosowano zachętę: „Samotny kowboj jedzie na koniu po otwartej równinie o pięknym zachodzie słońca, delikatnym świetle i ciepłych kolorach”.

Google twierdzi, że od dzisiaj nowe narzędzia kreatywne AI będą dostępne dla wybranych twórców wyłącznie w ramach prywatnego podglądu, ale listy oczekujących będą otwarte.