Dołącz do naszych codziennych i cotygodniowych biuletynów, aby otrzymywać najnowsze aktualizacje i ekskluzywne treści na temat wiodącego w branży zakresu sztucznej inteligencji. dowiedz się więcej

Nvidia sfinalizowała przejęcie biegnij: maszProducent oprogramowania, który ułatwia klientom udostępnianie chmur GPU dla sztucznej inteligencji, oświadczył, że udostępni oprogramowanie na zasadach open source.

Cena zakupu nie została ujawniona, ale kiedy Nvidia po raz pierwszy poinformowała o zamiarze zamknięcia transakcji w kwietniu, wynosiła ona 700 milionów dolarów. Run:AI opublikowało dzisiaj wiadomość o transakcji na swojej stronie internetowej, a firma podała, że Nvidia planuje dodatkowo udostępnić swoje oprogramowanie na zasadach open source. Oprogramowanie firmy zdalnie planuje zasoby GPU Nvidia dla AI w chmurze.

Żadna z firm nie wyjaśniła, dlaczego Run:ai udostępni swojej platformie oprogramowanie typu open source, ale prawdopodobnie nie jest to trudne do zrozumienia. Odkąd Nvidia stała się producentem nr 1 chipów AI, wartość jej akcji wzrosła do 3,56 biliona dolarów, co czyni ją najcenniejszą firmą na świecie. Jest to świetne rozwiązanie dla Nvidii, ale nadzór antymonopolowy utrudnia jej przejmowanie firm.

„Z przyjemnością witamy zespół Run:AI w Nvidii” – powiedział jedynie w oświadczeniu rzecznik Nvidii.

Kiedy Microsoft przejął Activision Blizzard za 68,7 miliarda dolarów, uspokoił organy antymonopolowe, udzielając licencji na gry Call of Duty firmy Activision na inne platformy na dekadę, mając nadzieję, że firma stanie się bardzo potężna w branży gier. Być może tutaj też dzieje się to samo.

Założyciele Run:AI, Omri Geller i Ronen Dar, oświadczyli w komunikacie prasowym, że otwarte pozyskiwanie oprogramowania pomoże społeczności szybciej budować lepszą sztuczną inteligencję.

„Chociaż Run:AI obsługuje obecnie tylko procesory graficzne Nvidia, otwarte pozyskiwanie oprogramowania umożliwi mu rozszerzenie jego dostępności w całym ekosystemie sztucznej inteligencji” – stwierdzili Geller i Dar.

Powiedzieli, że będą nadal pomagać swoim klientom w maksymalnym wykorzystaniu infrastruktury sztucznej inteligencji i oferować ekosystemowi maksymalną elastyczność, wydajność i wykorzystanie systemów GPU, gdziekolwiek się znajdują: lokalnie, natywnie w chmurze za pośrednictwem rozwiązań lub na platformie Nvidia. DGX Cloud, opracowany wspólnie z wiodącymi dostawcami usług CSP.

Założyciele powiedzieli również: „Zgodnie z naszą filozofią otwartych platform, jako część Nvidii, będziemy nadal zapewniać zespołom AI swobodę wyboru narzędzi, platform i frameworków, które najlepiej odpowiadają ich potrzebom”. Będziemy nadal wzmacniać nasze partnerstwa i ściśle współpracować z ekosystemem

„Oferuj szeroką gamę rozwiązań AI i opcji platform”.

Izraelska firma stwierdziła, że kiedy została założona w 2018 roku, jej celem było stać się siłą napędową sztucznej inteligencji

Rewolucjonizacja i umożliwienie organizacjom uwolnienia pełnego potencjału infrastruktury sztucznej inteligencji.

„W ciągu ostatnich kilku lat nasz światowej klasy zespół osiągnął kamienie milowe, o których wówczas mogliśmy jedynie marzyć. „Wspólnie stworzyliśmy innowacyjną technologię, niesamowity produkt i niesamowity silnik wejścia na rynek” – powiedzieli założyciele.

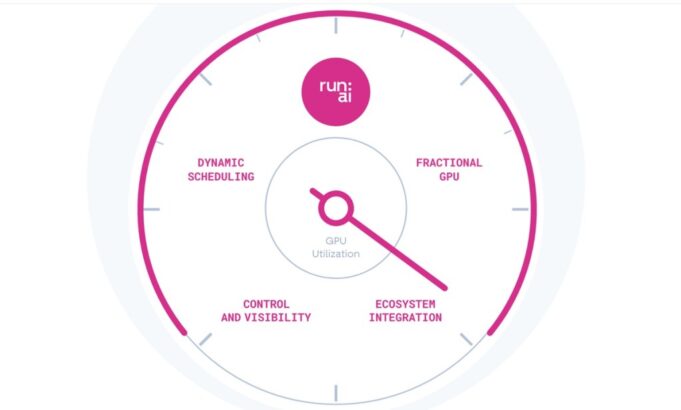

Run:AI pomaga klientom organizować infrastrukturę AI, zwiększać wydajność i wykorzystanie oraz zwiększać produktywność ich zespołów AI.

„Jako część Nvidii jesteśmy podekscytowani możliwością wykorzystania tego impetu. „Sztuczna inteligencja i przyspieszone przetwarzanie danych zmieniają świat w niespotykanym dotychczas tempie i wierzymy, że to dopiero początek” – powiedzieli założyciele Run:AI. „Infrastruktura GPU i AI będzie wiodącą siłą napędową tych rewolucyjnych innowacji, a dołączenie do Nvidii daje nam niezwykłą okazję do realizacji naszej wspólnej misji, jaką jest pomaganie ludzkości w rozwiązywaniu największych wyzwań świata”.

Nvidia od dawna jest producentem układów graficznych, a w ostatnich latach chipy te stają się coraz bardziej przydatne do uruchamiania oprogramowania AI. Obecnie firma kładzie nacisk również na oprogramowanie, a to przejęcie ma na celu zapewnienie klientom maksymalnego wyboru, wydajności i elastyczności oprogramowania do orkiestracji GPU. Nvidia i Run:AI współpracują ze sobą od 2020 roku i mają wspólnych klientów.

TLV Partners prowadziło rundę zalążkową Run:AI w 2018 r. „Na początku 2018 roku rynek sztucznej inteligencji wydawał się być innym światem” – stwierdziła w oświadczeniu Rona Segev, dyrektor zarządzająca TLV. OpenAI nadal było firmą badawczą, a kapitalizacja rynkowa Nvidii wynosiła „tylko” około 100 miliardów dolarów. Spotkaliśmy się z Omrim i Ronenem, którzy namalowali dla nas obraz przyszłości sztucznej inteligencji. W jego wizji przyszłości sztuczna inteligencja była wszechobecna.

„Każdy na świecie będzie codziennie miał kontakt ze sztuczną inteligencją i będzie jasne, że każda firma będzie w jakiś sposób korzystać ze sztucznej inteligencji” – powiedział Segev. Według niego jedyną rzeczą, która powstrzymywała tę wizję od urzeczywistnienia, był brak wydajności i kosztów związanych ze szkoleniem modeli AI i uruchamianiem ich w środowisku produkcyjnym na wielu klastrach GPU. Aby rozwiązać ten problem, Omri i Ronen wprowadzili pomysł stworzenia warstwy orkiestracji pomiędzy modelami AI i procesorami graficznymi, która umożliwiłaby bardziej efektywne wykorzystanie podstawowych zasobów obliczeniowych, przyspieszając w ten sposób czas szkolenia i znacznie redukując koszty.

Segev dodał: „Oczywiście w tamtym czasie było to wszystko teoretyczne, ponieważ nie zarejestrowano jeszcze firmy, nie mówiąc już o produkcie. Nie wiedzieliśmy wtedy zbyt wiele o tej branży. Ale było coś wyjątkowego w Omrim i Ronanie. Miał wyjątkową kombinację inteligencji, uroku, szaleństwa i pokory, która stworzyła idealną receptę na typ założycieli, do których chcemy wracać.

Source link